ライブ演出 – “理想”と“現実”の狭間で

ライブ演出例① 特徴的な形状の可動パネルモニター

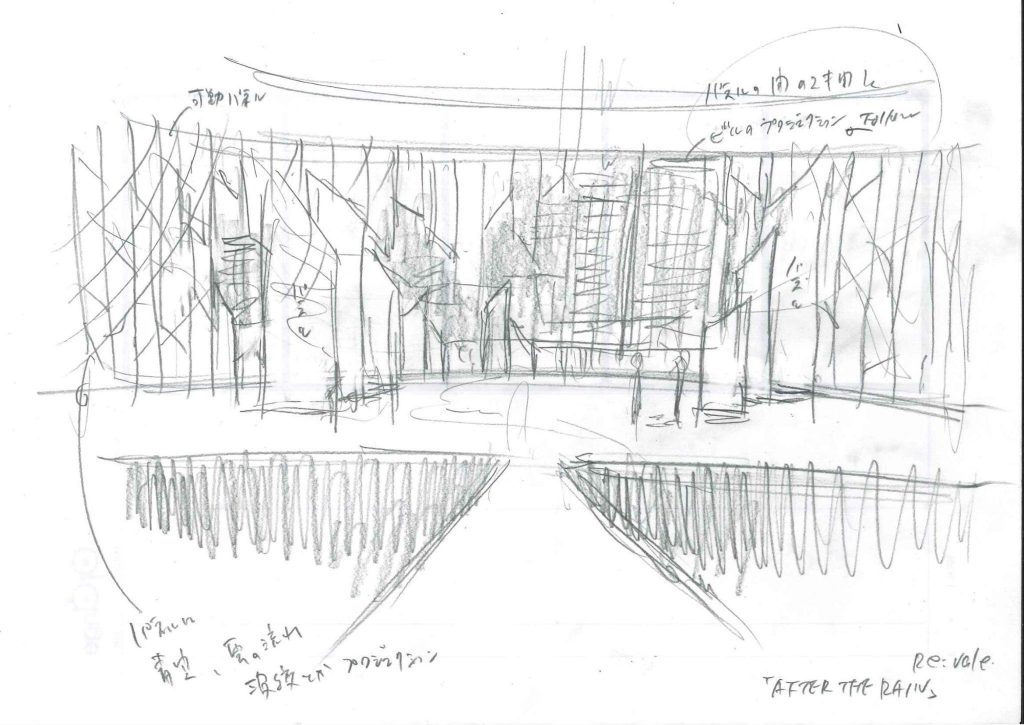

ラフスケッチ

ステージ演出でキーになったのが随所に登場する特徴的な形状の可動式パネル型モニター。ラフスケッチ時点でもさまざまなサイズのパネルが登場することが想定されている。

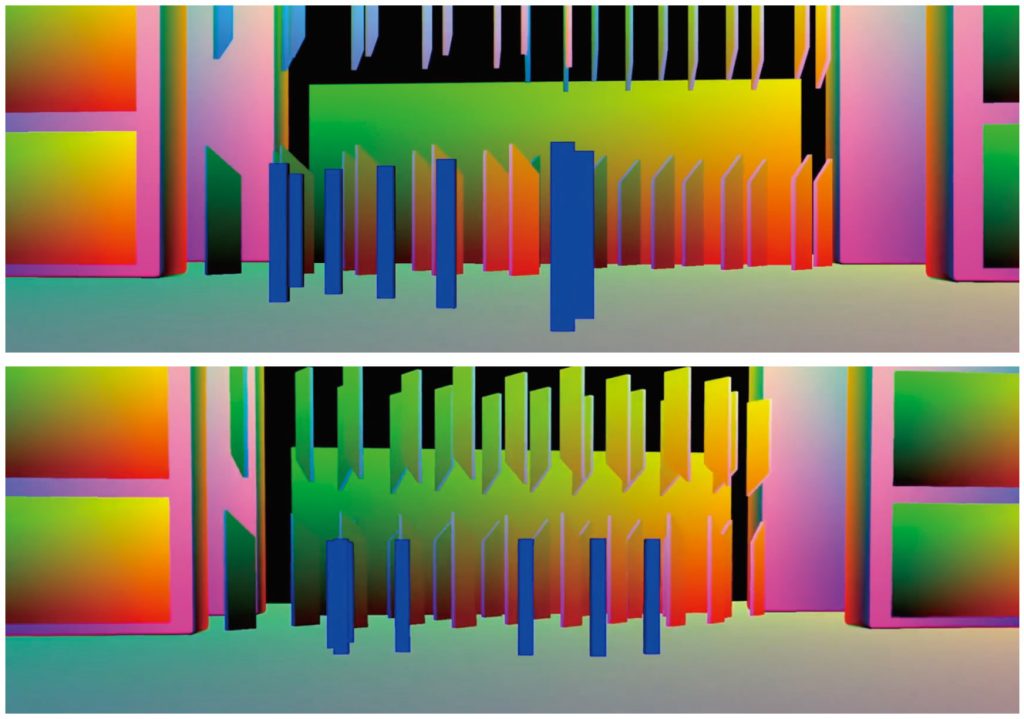

テスト映像

山本さんがパネルの動きをテストした際の映像。各パネルが動きながら合体して、ひとつの大きなモニターを形づくるような演出にできないか、またそのような動きにする場合はどのぐらいの速度にすべきかを検討した。

ライブ演出例② 転換するステージのリアリティ

“ファンタジー”ではないライブ演出と方法論を模索したモーションキャプチャ

リアリティを追求したライブ演出の例として、“実際にあるテクノロジーに基づいた仕掛け”も挙げられます。例えばハイライトのひとつになっている舞台上の「巨大ツリー」。これはドローンアートによって表現することにしました。演者の上空に点在していた小さなドローンが集まってきてツリー型になるという演出です。現実的には本編のような繊細な飛行はできないかもしれませんが、数年後には実現するのではないか、という希望的な予測も込みで盛り込むことにしました。

あとは「ティーカップ」の演出。360度自在に移動できる球形のタイヤがティーカップの底に仕込まれているという設定なのですが、このタイヤのコンセプトは実在するんです。こちらも近い将来実現するであろう技術としてライブ演出に組み込むことにしました。そのほか「流れる溶鉄」「燃えるカーテン」などの演出も実現できそうな技術からは逸脱しないように注意して、リアリティを担保した形で考案していったんです。

こういったライブ演出が固まったらアイドルたちのパフォーマンスを作っていきます。振付師やダンサーの方たちにも入っていただいて、振付→リハーサル→モーションキャプチャという工程を踏みました。まず錦織監督の演出に基づいて振付師がダンスを構築、その後リハーサルで徹底的に追い込み、完成した振付をモーションキャプチャへと移していったんです。

モーションキャプチャの現場は人数的にも空間的にも制約が多く、そのままでは成立しない部分をスタジオとオレンジのキャプチャチームが方法論を模索しながら補っていきました。演者(ダンサー)とキャラクターの体格や動きの違い、また複数テイク間のズレを補正し、最終的にすべてがひとつに繋がったときに舞台演出が完成する、ということですね。この舞台演出こそが、今作の制作の大きな特徴であり、ライブをテーマにした作品で多く使われるであろう制作ステップでもあります。

ライブ演出例③ 巨大ツリーと“空飛ぶ”ティーカップ

ドローンアートとして表現した巨大ツリー

舞台上を飛行していたひとつひとつの小さなドローンが集合し、巨大なツリーを形づくる…という演出。木のオブジェを設置する案も検討されたが、最終的にはドローンアートで表現することに。3DCGのデータを細かく見るとドローンのプロペラも仕込んである。

360度自在に動くタイヤが仕込まれたティーカップ

当初は空飛ぶティーカップのアイデアもあったが、それを実現するにはワイヤーかレールが不可欠になってしまうため、ステージ上を自在に滑るような仕掛けに変更した。

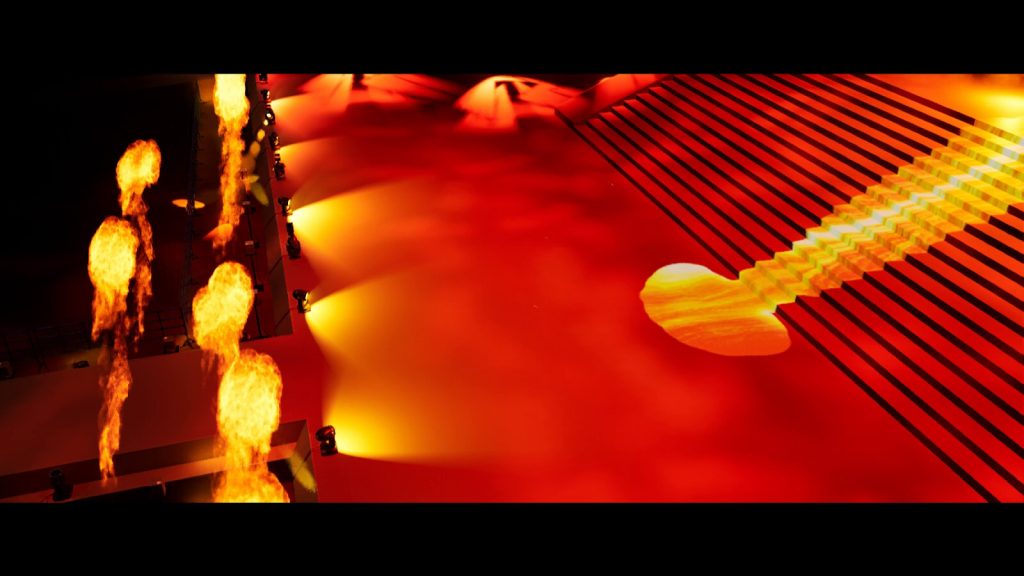

ライブ演出例④ 流れる溶鉄と燃えるカーテン

モーションキャプチャ– 身体を重ねるプロセス

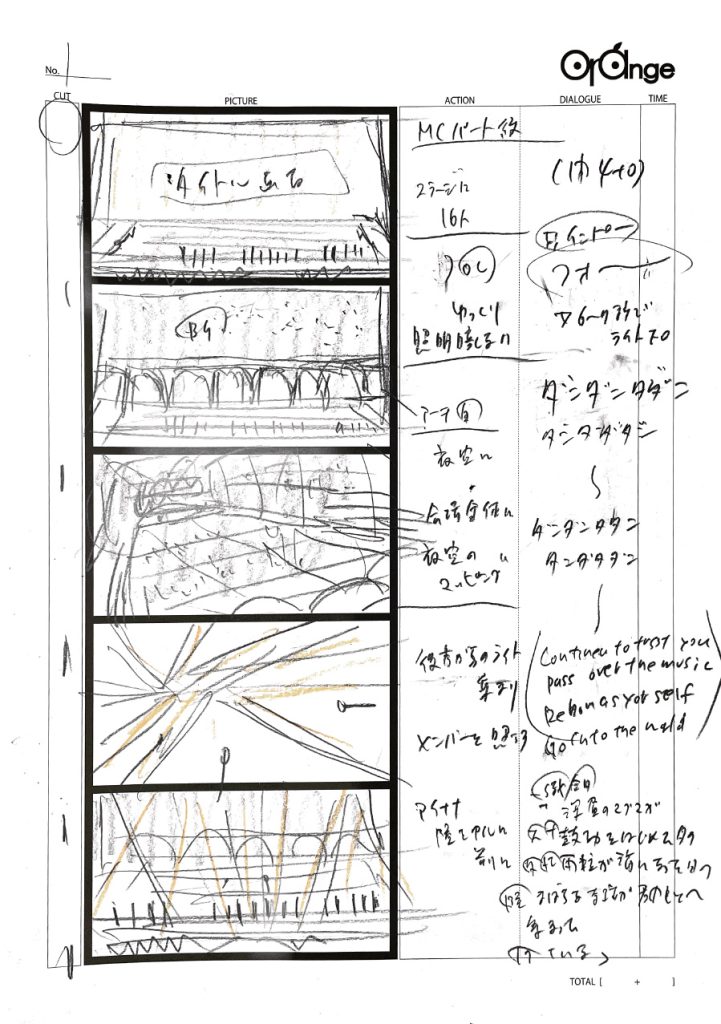

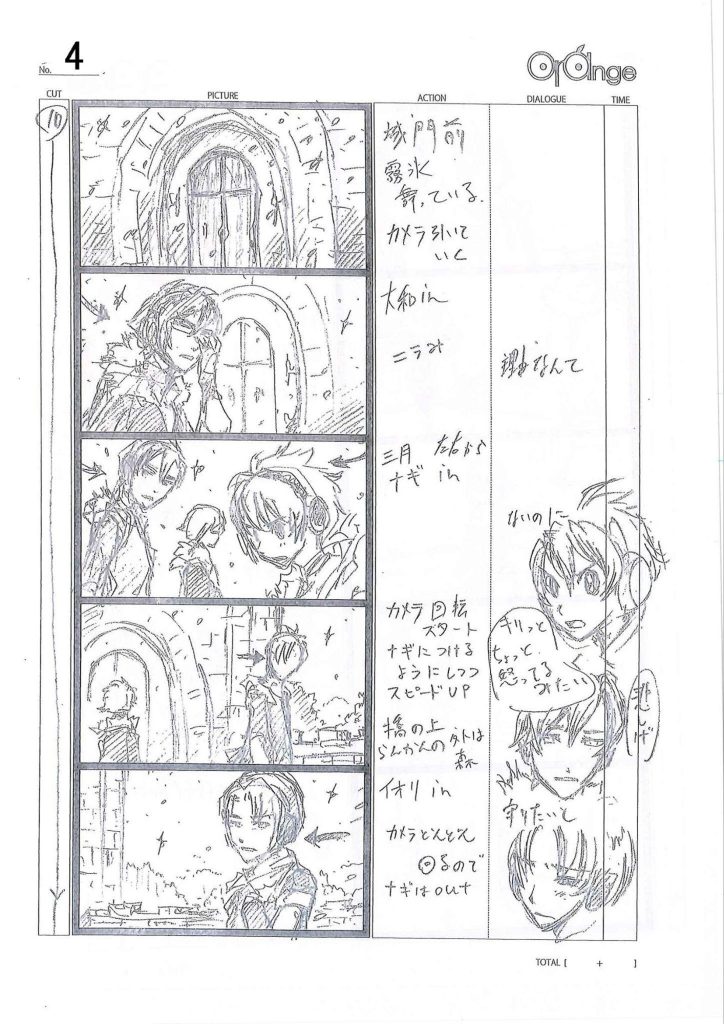

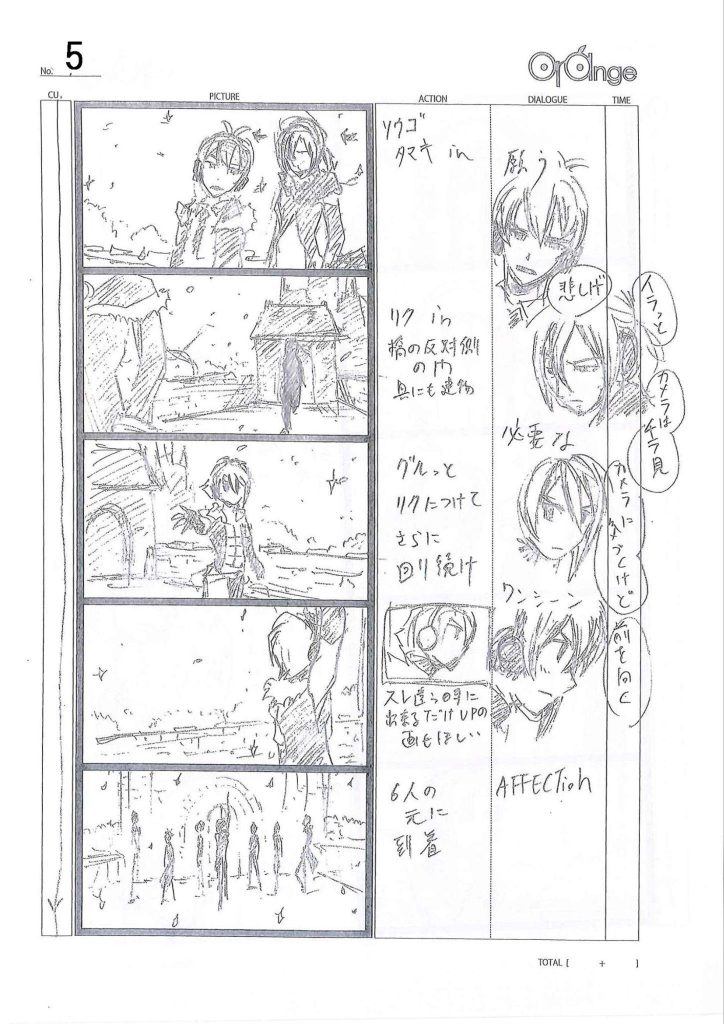

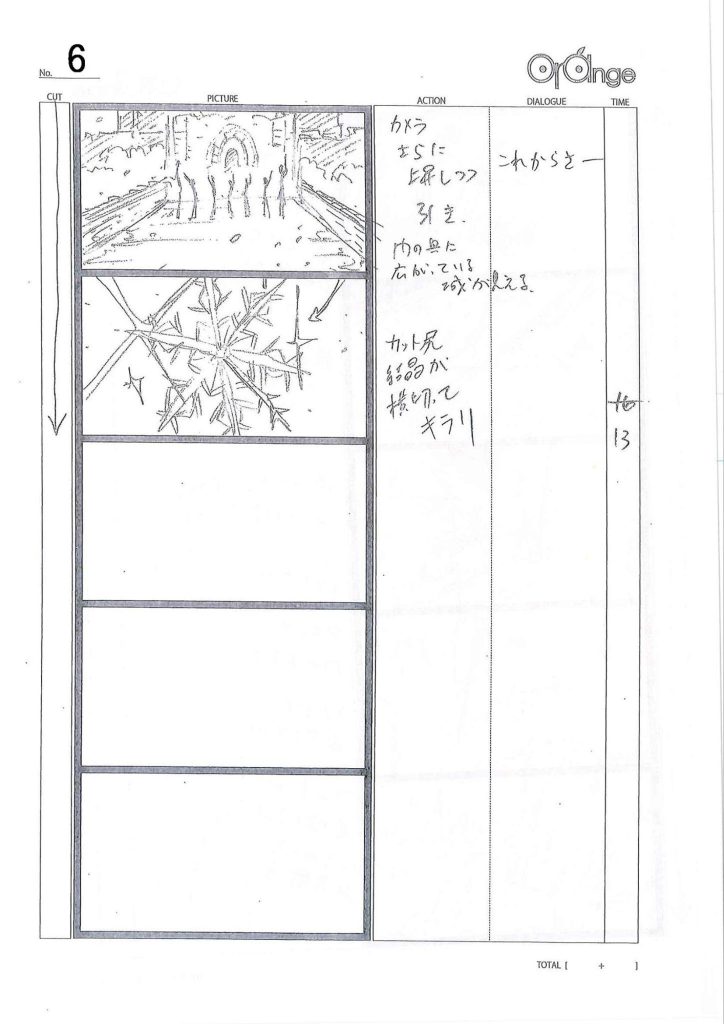

パフォーマンスありきのムビナナで唯一存在したコンテらしきもの

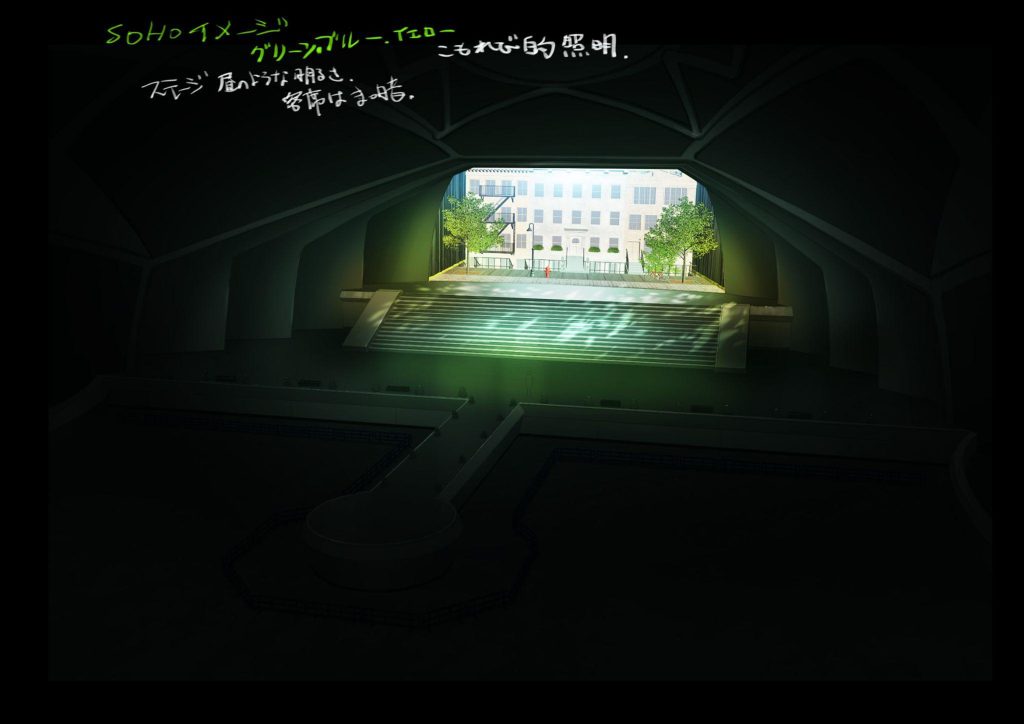

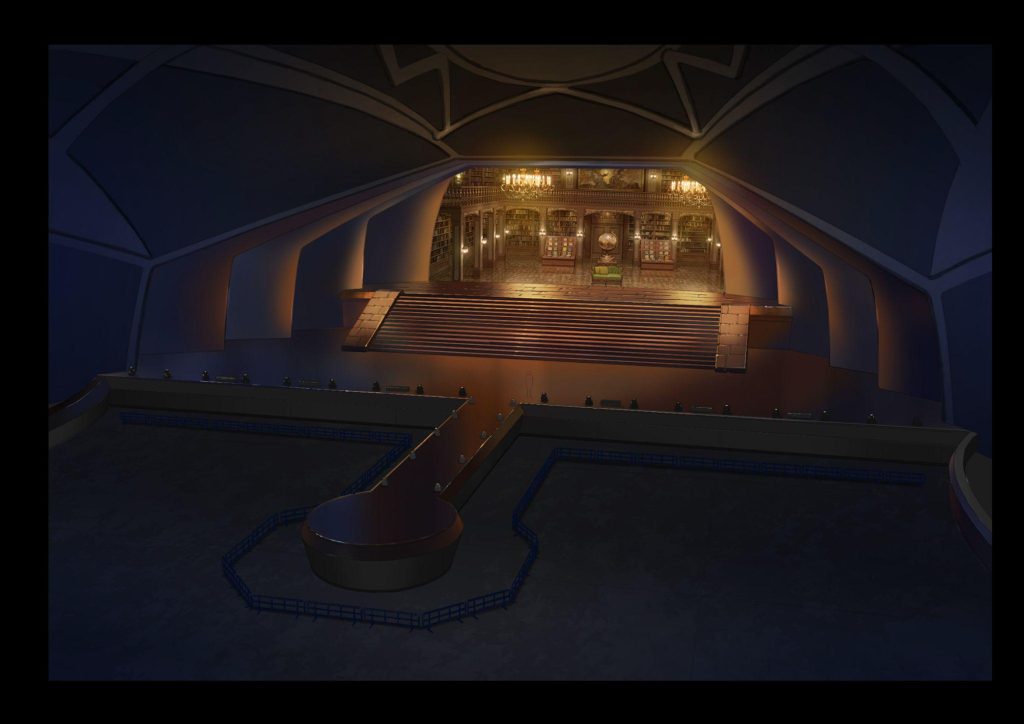

作品全体として「コンテを作らない」ということが制作のテーマのひとつになっていたムビナナ。しかし、振付師などがパフォーマンスを作っていく際に全体の流れを説明するためのステージを俯瞰したような図説としてのコンテだけは存在していた(左画像は楽曲「Pieces of The World」のコンテらしきもの)。つまり、画づくりのためのパフォーマンスではなく、あくまでパフォーマンスありきで、それを画にしていく…という順序だった。

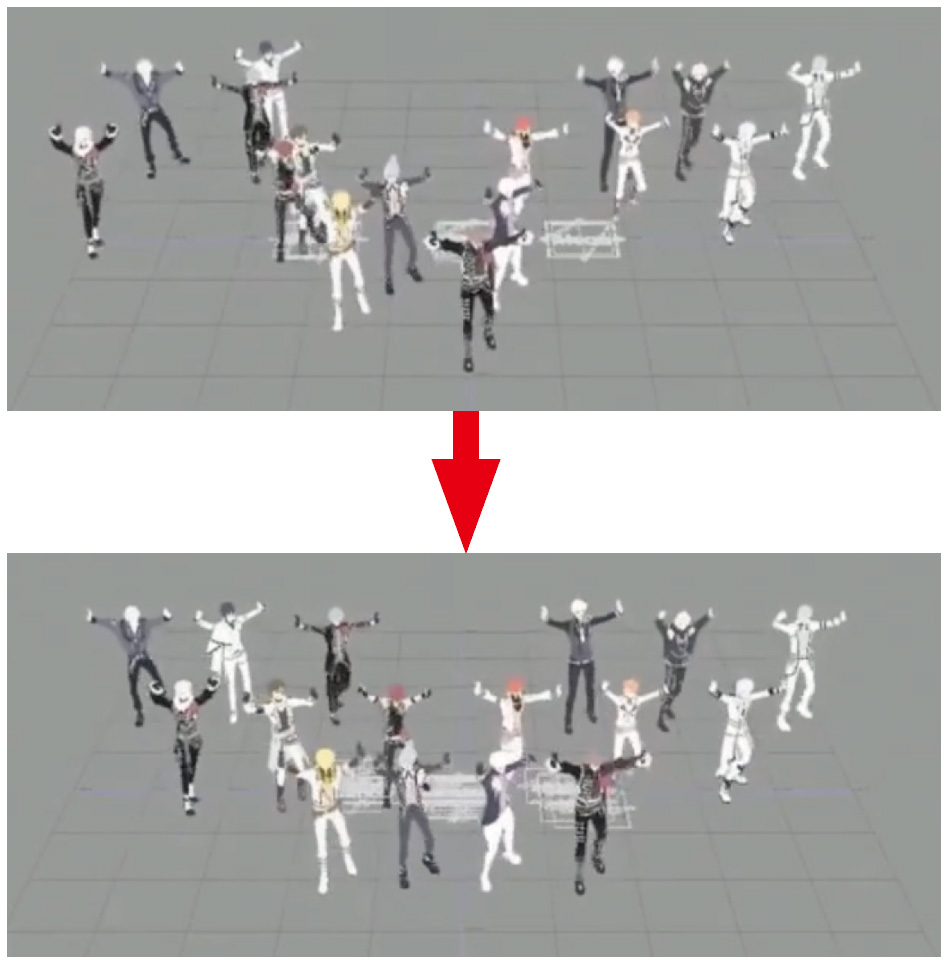

モーションキャプチャデータの編集 (ビフォーアフター比較)

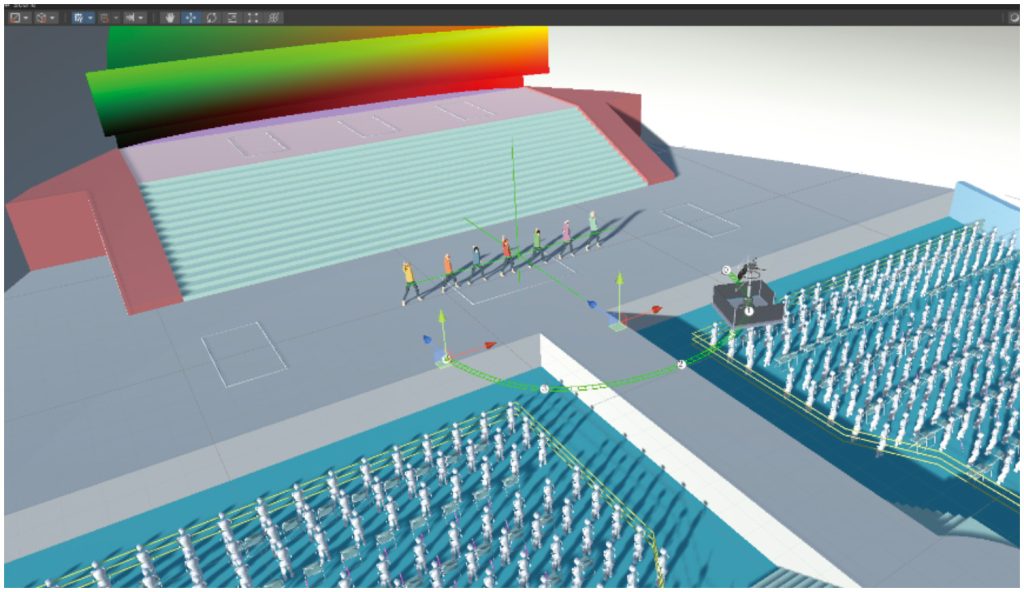

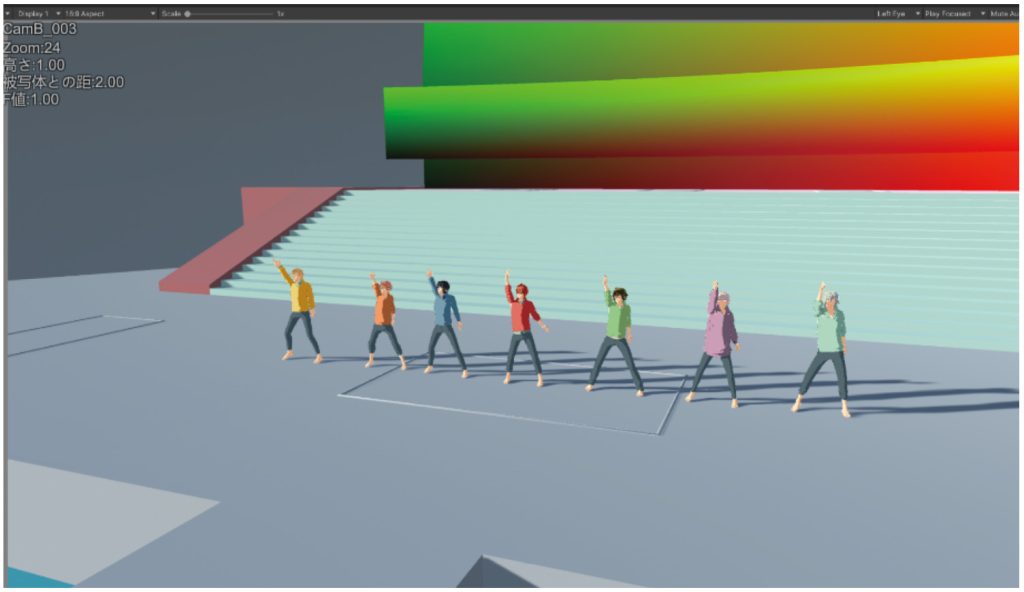

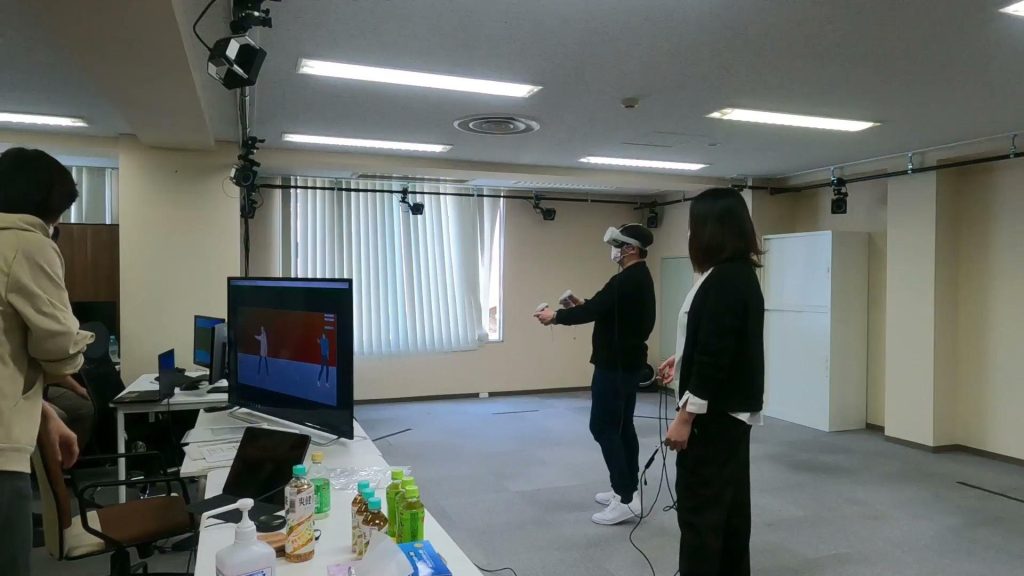

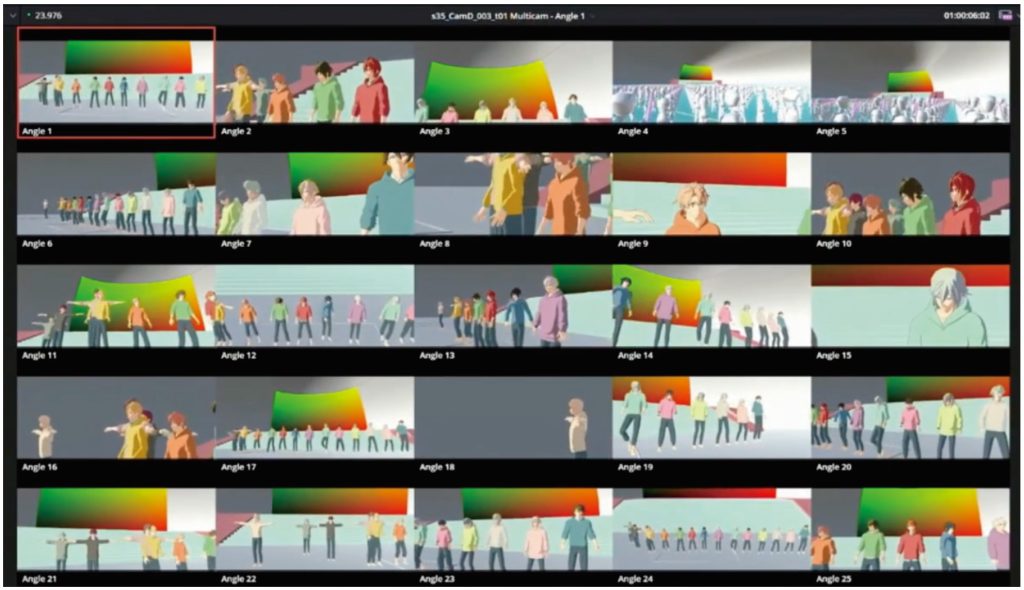

アングルとカメラワークを試行錯誤したVR空間内での撮影プロセス

VR環境での撮影は自由度が高すぎるがゆえに、やりすぎれば映像がウソっぽく見えてしまう。そこで、錦織監督と山本さんは“リアリティを損なわないギリギリ”を探りながら撮影を進めた。キャラクター単体に注目する回、全体をワイドで捉える回、望遠で圧縮感を出す回…といったように、テイクごとにテーマを設定し、最適なカメラワークも模索しながら撮影を行なったそうだ。

VR空間内に設置されたオートカメラの映像

錦織監督のカメラ映像と撮影風景

山本監督のカメラ映像と撮影風景

VR撮影の結果

各楽曲およびMCにおいて、基本的にはそれぞれ100弱のオートカメラと20強のVRによるハンディカメラで撮影。カメラが特に多かった楽曲「Pieces of The World」では、固定カメラ119台、ドリーカメラ24台、ドローンカメラ19台、ハンディカメラ31台の合計185台で撮影された。このカメラ台数の多さもVR撮影ならでは。

あえてセオリーを外してリピートを生むような編集

VR撮影された映像をオフライン編集マンに共有し、画コンテなしの環境でイチから楽曲・MCを含む全シーンの編集作業を行なった。目指したのはセオリーを外して“リピートを生む”編集。パフォーマンスをフラットに撮った素材を編集によって意味づけ。視線誘導をあえて散らすことで、一度見ただけでは把握できない密度の高い画面構成にし、劇場にリピーターを生む仕組みを作ったという。

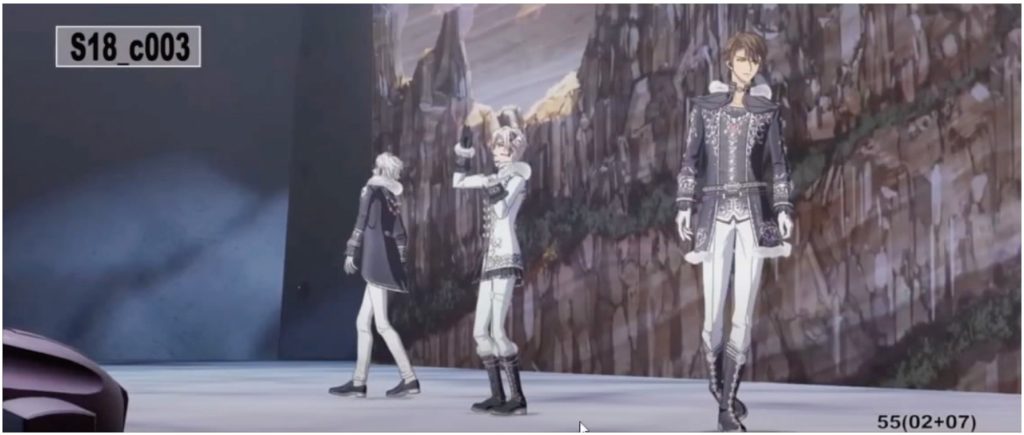

レイアウト

プライマリ

セカンダリ

フェイシャル

コンポ

演出手法の比較 – MVと劇場版の違い

ライブをリアルタイムで撮影するか、グリーンバックやセットで撮影するか

山本さんが監督した「アイドリッシュセブン」シリーズの『Mr.AFFECTiON』MVは事前に絵コンテがあり、「実在するアイドルをグリーンバックやセットで撮影した」という考え方で制作。ムビナナはライブ演出と映像の演出が切り離れていたが、本MVではパフォーマンスそのものの演出が先行しつつも映像演出が主体になっている。

BLACK OR WHiTE 『Mr.AFFECTiON』MV

演出のひとつの形として広く使われるようになっていくかもしれない

今回の話をまとめると、ライブ演出と映像演出という2段階の構造をとることで、通常とは異なる制作プロセスが生まれました。VR撮影ではレイアウトを含めた映像演出をしつつも、それは必ずしも完成作品に残るとは限らない、というのもポイントでした。あくまでVR撮影素材は演出された素材でしかなく、完成版の画ではありません。なのでリアリティを重視しつつも、3DCGの特性を活かして非現実的な理想を繊細に盛り込むというのが本作の全体的な演出意図でした。

加えて、音響のこだわりも演出の一部と言えるかもしれません。通常では画面に登場しているキャラクターの声をメインにしますが、ムビナナのステージ上では全員オンマイクでパフォーマンスしているので、画面外にいるキャラクターの声もしっかりと拾っています。あと、通常は拾わない声、息遣いや雑談も拾って伝えるようにしているので、結果的にお客さんが見に行った劇場の環境次第で違う音、声が聞こえることになりました。編集と同じようにセオリーを外した演出ですね。一度では見切れないような複雑さを意図的に仕込み、観客にリピート視聴を促した、ということです。

これは“ライブをそのまま映画にした”からこそ可能となった、新しい映画体験かもしれません。大きく言えば、作り方そのものを演出した作品になっているはずです。もちろんどんなタイプの映画にも適用できる手法ではありませんが、“何度でも見れる映画体験”を成立させる方法として、珍しい手法ではなく演出のひとつの形として広く使われるようになっていくのではないかと思います。

この作品が完成したときに、ライブ映画として完成度の高いものができたという自負がありました。シリーズを知らない人、ファン以外の人でも面白いと思ってもらえる作品になったな、と。僕の周りの人は「いい作品ではあるけど、それは言い過ぎじゃない…?」という空気感でしたが、蓋を開けてみるとこの映画から「アイドリッシュセブン」シリーズにハマった人もいるそうなんです。ストーリーがない作品だからこそ、フラットにライブとして楽しんで、「このアイドルたちのことをもっと知りたい!」となったケースもあったというのが、ひとつの発見でした。

僕は演出の経験自体はまだまだですが、ムビナナのような作り方を体験したからこそできる手法、3DCGを知っているからこそできる演出もあると思いますので、これからも精進していろんな作品を作っていきたいです。