4月18日と20日にソニーPCLが開催した「Virtual Production Boost 2024」。日本国内のみならず海外からもゲストを招いてバーチャルプロダクション関連のセミナーやワークショップが多数開催された。盛況のうちに開催された今回のイベントのうち、ここではソニーPCLが制作に参加した『王様戦隊キングオージャー』を事例にしたトークセッションの様子をお届けする。

スピーカー●上堀内佳寿也、遠藤和真(ソニーPCL)

モデレーター●沼倉雄人(Vook)

取材・文●編集部 伊藤

バーチャルプロダクションによる撮影を振り返る

王様戦隊キングオージャー

物語の舞台となるのは5つの国からなる「チキュー」。メンバー全員が王様のスーパー戦隊という、これまでに類を見ない設定もさることながら、CG技術を駆使したハイクオリティな映像により、ファンだけでなく映像業界からも大きな注目を集めている。戦隊シリーズ初となる昆虫モチーフのロボとともに敵と戦い、平和のために奮闘する王様たちの姿を描くファンタジー大作。

上堀内監督とバーチャルプロダクションプロデューサー・遠藤さんが登壇

沼倉 セッションのモデレーターを務めさせていただくVook編集部の沼倉です。よろしくお願いします。このセッションではメイン監督を務められた上堀内佳寿也監督と、ソニーPCLのバーチャルプロダクションプロデューサーの遠藤和真さんに登壇いただきます。最初に自己紹介も兼ねて、作品における具体的な役割を一言ずつお願いします。

上堀内 東映さんの特撮シリーズ・『王様戦隊キングオージャー(以下、キングオージャー)』という作品のメイン監督をしました、上堀内と言います。よろしくお願いします。

遠藤 「清澄白河BASE」でバーチャルプロダクションのプロデューサーを担当している遠藤と申します。

沼倉 仕事柄もありますが、僕はこの作品を全話見ていまして。

上堀内 ありがとうございます。

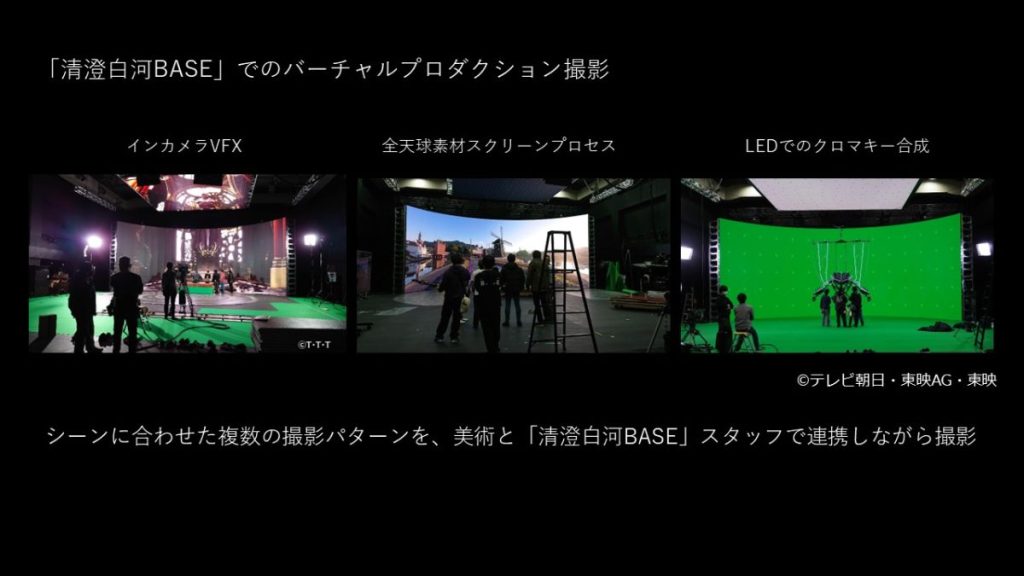

「清澄白河BASE」でのバーチャルプロダクション撮影

沼倉 素朴な質問から入らせていただきたいんですけど、バーチャルプロダクションでの撮影のうち、「清澄白河BASE」で撮影した割合はどのくらいですか?

上堀内 撮影ってだいたい「組」で分けるんです。30分作品の3話分をひとりの監督の組で撮るんですけど、14日間くらいで撮った中の3日間くらいですね。

沼倉 なるほど。本編のカットの割合としてはどれぐらいになるんですか?

上堀内 撮影日数は3日ほどですが、「清澄白河BASE」さんで撮らせてもらったものは結構な割合になります。本編尺が20分ちょっとあるなかで、10分くらいを「清澄白河BASE」で撮影している回もありましたね。

沼倉 遠藤さんはこれぐらいのボリュームの撮影ははじめてですか?

遠藤 はじめてですね。物量がどれくらいになるか、まだわからない段階から始めた分、全体像をつかみながら本番が撮影されていく、というスタートを切った感じですね。

上堀内監督の「夢」とは⁉

沼倉 わかりました。撮影のBTS動画がYouTubeで公開されているので、まずはそちらをご覧ください。

沼倉 時間も限られているので映像を流しながら進めていきたいと思います。今まさに「夢が叶ったんだな」というパワーワードが出ましたが(YouTube 0:12)、どういうことか具体的に教えていただけますか?

上堀内 1年間のTVシリーズなので毎週放送しないといけないところを、本編の内容的にも8割方バーチャルプロダクションを使った撮影をしたいという思いがあって。でも準備期間が1年切った状態でスタートしたので失敗ばっかりだったんです。壁にぶち当たって「これをミスるとバーチャルプロダクションでの撮影ができない」という段階のときに、ソニーPCLさんと「清澄白河BASE」の皆さんに出会うことができました。

撮影の時間や労力を考えたときに、インカメラVFXを使ったLEDウォールでの撮影と、クロマキーを使ってその場で背景をはめ込む「ライブ合成」と呼んでいる手法の両方をひとつのスタジオの中で同時にやりたかったんですよ。そこが先ほど映像で出た僕の「夢」です。

そもそもそれ以前に、まずバーチャルプロダクション自体ができないかもという状況が、ソニーPCLさんと一緒にやることによって、そこの次の段階の夢まで叶ったというの意味合いの笑顔です。一回どん底に落とされて、その後に思っていた以上の崖の上に登れたような感覚でした。

現場で用いられた撮影手法

沼倉 おもにふたつの撮影手法があるということでしたが、具体的にどういう手法を用いられたか教えてください。

遠藤 Unreal Engineで背景CGを現場のカメラについているセンサーと連動させて撮るインカメラVFX。これがバーチャルプロダクションの中心的な技術ですね。この手法に加えて先ほど監督がおっしゃっていたクロマキーを使用して、ライブで合成していくことも必要なので、LEDウォールにグリーンを表示させてクロマキー合成をしていくやり方(ライブ合成、L合)。あとは、アセットとして360°の実写素材を実景として出すスクリーンプロセス、この3つの手法でやらせていただきました。

沼倉 それぞれどういうシーンで使い分けられていたんですか?

上堀内 インカメラVFXとクロマキーの差は撮影の範囲です。画角として引きたいかどうかが一番わかりやすい区分けだと思います。あとは自然物は自然光も含めてスクリーンプロセスのほうがなじみがいいので、大きくそういう分け方で撮影しました。

脈々と受け継がれる特撮文化と現場でのチームビルディング

沼倉 ありがとうございます。スーパーヒーロー戦隊シリーズは数年前からCG合成が増えてきていますが、バーチャルプロダクションの本格的な導入はこの作品が最初になりますか?

上堀内 キングオージャーの前に『仮面ライダーギーツ』という作品でやっていたところもありますが、こんな割合で1年間やろうという人たちは僕らだけでしたね。元々はコロナ禍にロケーションでの撮影っていうのをいかに減らせるかというのと、今回ファンタジー作品だったのでロケ地がなかなか日本になかったので、バーチャルプロダクションの割合が増えました。

沼倉 ありがとうございます。メインテーマに立ち戻ると、「日本特撮の可能性」を実感した作品かなと思うんですけど。

上堀内 大きく出ましたよね。

(一同笑)

沼倉 ソニーPCLさんとしては特撮シリーズがはじめてだったでしょうし、監督もガッツリバーチャルプロダクションで撮るのははじめてだったと思うのですが、試行錯誤しつつもどうやってチームビルディングしていったのでしょうか?

遠藤 うちのスタジオの軸で言うと普段は単発の作品を取りにいらっしゃるチームとその都度打ち合わせして、下見して本番という形がほとんどです。

東映さんが定期的にスタジオに入ってこられるようになって、そこから現場でコミュニケーションが取れるようになっていったという感じですね。最初は、台本に書いてある「L合」という用語などがわからないようなところからのスタートでした。

上堀内 そうですよね、独自の言葉すぎますよね。

遠藤 もっと言うと大泉学園にある東映さんのスタジオで使うUnreal Engineのアセットと、「清澄白河BASE」のLEDウォールで使うアセットは同じものですが、送出の仕組みが違うので持ってきてそのまま映し出すことができませんでした。なので、アセットをLEDウォールに出せるように最適化するというステップを最終的には組ませていただきました。

上堀内 ご一緒できるとわかったタイミングがOAの2、3カ月前ぐらいで、時間がなかったんです。本当は万全の状態でできるのがベストなのでソニーPCLさん側には本当に申し訳なかったんですけど、撮影しながらの調整も覚悟していたんです。システムの違いなどからトラブルはいっぱい起きましたが、何かあってもその場で代案を考えようとか、次来たときには改善しようねという形で進めさせてもらったので、一緒に歩めたのかなと思います。

沼倉 こんな感じでやっていけば求めるクオリティに達した上で回していけるなという段階にいたるまでどれくらいかかりましたか?

上堀内 僕の場合は最初の5話分をいっぺんに撮らせてもらったので、その撮影が終わるころにはこういうふうにコミュニケーションを取っていけばやっていけるんだなというのが見えましたね。

沼倉 コミュニケーションを取るうえで監督として心がけたことはありますか?

上堀内 細かいコミュニケーションを取らないと混乱するだろうなと思ったので、例えば次にやることを東映チームだけでなくソニーPCLさんのチームにも直接伝えに行くといったようなことを心がけていました。システム自体ははやいので、コミュニケーションの部分を意識すればいけるんだなと思っていました。

沼倉 それが最初におっしゃっていた「夢が叶った」ということですか?

上堀内 そうです。1カ所のスタジオで、ボタンひとつでインカメラVFXとクロマキーでの撮影を切り替えるのが僕らの夢だったんです。でもいろんなところでそんなことはできないよ言われていて。

ドラマや映画はお芝居を決め込んで撮るわけではないので、例えば同じシーンなのにこのカットはインカメラVFXだから別のスタジオで撮りましょう、クロマキーだから別日に撮りましょうという撮影の方法だとやっていけないだろうなって思っていました。そういう懸念があったので、バーチャルプロダクションを取り入れることに一歩踏み出せなかったんですよね。

結局ボタンひとつは言い過ぎですけど、インカメラVFXとクロマキーを5分かかるかどうかくらいでチェンジすることができたのでその懸念がなくなりました。

沼倉 遠藤さんからインカメラVFXとクロマキーのシステムの切り替えについての補足をお願いでできますか?

遠藤 バーチャルプロダクションでインカメラVFXをやるときには大型のLEDに対してUnreal Engineを、リアルタイムでレンダリングするマシンを使っています。このマシンと、グリーンバックを出すシステムや実写の映像や画像を出すシステムはサーバーが違うので、解像度や画角に合わせて最適化していかないといけません。ソニーPCLでも自社サーバーを交えながらスタジオ技術の拡大をしているなかで、スタジオがオープンしたときはUnreal EngineでインカメラVFXをやることが前提でしたが、今回のようにシステムを切り替えたりミックスしたりといった運用ができるようになってきたタイミングでのご相談だったんです。多分半年前だったらギリギリできないこともありました。

上堀内 そうだったんですね。「ずっとやってきましたよ」みたいなスピードでやってたから…(笑)

沼倉 じゃあ本当にちょうどいいタイミングだったってことですね。

作品の性質とバーチャルプロダクションの相性の良さ

沼倉 キングオージャーは5つの王国がまったく違うじゃないですか。クオリティを担保しながら描く上でやはりバーチャルプロダクションが必要だったのでしょうか?

上堀内 5人の王様がいて、5つの国を文化から表現するときに、通常のテレビドラマだと背景よりも手前の人物のお芝居がメインになりますが、今回の作品は世界観の表現が重要だったので、お芝居しているバックのビジュアルに説得力がないと見ているお客さんも飽きてしまうだろうなと思っていました。それを表現するにはUnreal Engineを使ったバーチャルプロダクションでないとロケーションの数がこなせなかったので、キングオージャーという作品にとってはもってこいのシステムだったのかなと思います。

沼倉 ありがとうございます。ちなみに役者さんの反応はどうでしたか?

上堀内 実は「清澄白河BASE」のスタジオで撮る前に1カ月弱ぐらい別のスタジオでクロマキーのみの撮影が始まっていたんです。現場のモニターにはリアルタイムで合成された映像が映し出されるのですが、目線の置き方や自分がいる場所をつかむのが難しくて役者さんが大混乱していたんです。当たり前ですけど、役者さんにとって自分がどこにいるのかはすごく大事で、実際にカメラの中で見た上で撮影すると、途中でクロマキーに切り替わっても対応しやすいようで、芝居がしやすいという声もありました。

沼倉 なるほど。一方で、特撮ならではのケレン味のあるシーンはVFXのほうが相性いいので、そのいいとこ取りをすることができたという面もあるのでしょうか?

上堀内 コンスタントに毎週放送のある作品なので、今回はどうしてもUnreal Engineでリアリティがあるところまで落とし込めませんでしたが、全体として視聴者に受け入れてもらえるクオリティまで落とし込めたかなと思っています。

視聴者を沸かせたボリュメトリックキャプチャによる戦闘シーン

「ボリュメトリックキャプチャ」とは?

沼倉 1年間にわたる制作の中でバーチャルプロダクションをきっかけに新たにボリュメトリックキャプチャも撮影手法として投入されたようなのですが、これについてもお話を聞かせていただきたいと思います。

上堀内 非常に活用させていただいきました。

(会場モニターでボリュメトリックキャプチャで撮影したシーンの一部を上映)

沼倉 これはどういったものか説明をお願いしたいです。

遠藤 (モニターに映ったシーンを指して)今、キャラクターが映っていますが、これはCGで作っているわけではなく、100台以上カメラがあるグリーンバックのスタジオで、実際に演技をした空間をそのままキャプチャーしています。本人が着ている衣装や身体性を伴った動きそのものがデータになる技術です。バーチャルプロダクションのLED撮影とは別に、VFXのCGカットに活用しています。

沼倉 ソニーPCLさんから技術をご提案されたそうですね。

遠藤 「清澄白河BASE」のバーチャルプロダクションスタジオの隣に、ソニーで開発したボリュメトリックキャプチャスタジオが運用開始になったのでお見せしました。

沼倉 監督はボリュメトリックキャプチャのどのようなところが魅力的だなと思ったのですか?

上堀内 僕の中で2点あって、一番はどこまでいわゆるスケジュールをコンパクトにできる点。モーションキャプチャと違って、人間のボーンを取った後に、CGをくっつける作業がないところです。あともうひとつは、時間がない中でどれだけそのCGの被写体に対して魂を入れられるか、より人間に見せられるかが勝負でした。

最初にお話いただいたときはアクションをとる予定もありませんでしたが、いかんせん新しいものを見るとやりたくなってしまうので、どこかで使わせてもらいたいなと思っていて実現したことでした。

沼倉 夏に公開された劇場版ではプロモーションでボリュメトリックキャプチャを使われたんですよね?

上堀内 そうです、プロモーションでダンス映像があって、(ボリュメトリックキャプチャで)どこまでやれるかを実験的に探れる機会をいただけたので、チャレンジさせてもらいました。そこからテレビシリーズの本編に活用できました。

SNSでも話題となったアクションシーン

沼倉 物語の後半、SNSでも話題になったアクションシーンが出てきますが、改めて具体的に教えていただけますか?

上堀内 ボリュメトリックキャプチャを本格的に使ったのは39話の放送です。テレビでこのクオリティで作ろうとすると通常は何カ月も前から準備が必要ですが、素材収録から撮影して納品まで実質1カ月ちょっとしかかかっていないはずです。本来の半分弱ぐらいの期間でやれるところにすごく魅力を感じました。

なぜそれができたのかというと、すべての工程を並行作業していたからです。素材を撮ってソニーPCLさんのほうでレタッチしてテクスチャーの解像度を上げてもらいながら、並行して解像度の低い簡易データをもらい、そのデータをUnreal Engineの中に入れました。そこで僕のほうで人物を配置してカメラワークを付けました。

僕が作ったものを送り返したらマスクの処理をしてもらって、合成会社に出す。合成部は簡易データで合成作業を始めて、そこでほぼ完成させちゃうんです。最後にレタッチされたデータをはめ替えて、微調整して納品という流れでした。

※東映公式HPにてボリュメトリックキャプチャの撮影時の様子を紹介中!

https://www.toei.co.jp/entertainment/tv/king-ohger/episode-guide/detail/1242477_3806.html

新技術によって拡張された映像表現

沼倉 見ていて表現としても新しさを感じました。監督として新たな表現手法を手に入れたという手応えはありましたか?

上堀内 背景用CGさえできればどんな作品にも対応できると思っているので、カメラの自由視点というのは僕らの作品でも課題でした。Unreal Engineを使っていろんなアングルに入れるのに、リアルなカメラワークでしか表現できないのは悔しいなと思ったんです。2Dのクロマキーでの人物の素材を撮ると、カメラワークに合わせた素材しか取れないのに対して、アングル関係なく素材を撮ってしまえば後からカメラワークをつけられるのが大きかったです。

遠藤 最後は「実際にそんなワイドなレンズないよ」というぐらいの画角も採用しましたよね。

上堀内 そうですね。実際に現場にあるレンズは11mmまでなんですけど、設定上6mmのカメラに11mmの素材をはめても意外と気にならなかったので、レンズの概念はだいぶ変わりましたね。

沼倉 ありがとうございます。この作品はバーチャルプロダクションとの相性の良さを体現した作品だと思うので、監督には引き続きいろんな形で新しい技術を使ってほしいです。皆さん、ご清聴いただきありがとうございました。

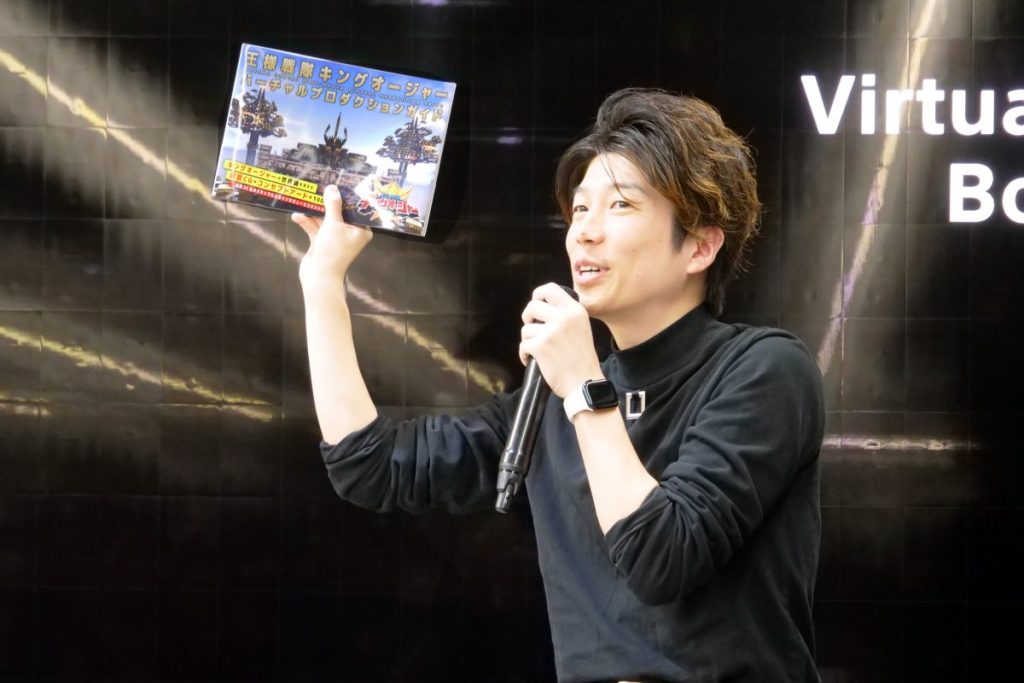

関連書籍も講評発売中!

「王様戦隊キングオージャー バーチャルプロダクションガイド」

作品の世界観を支えたCG背景のビジュアルを中心に掲載した書籍を発売中!バーチャルプロダクションによって『王様戦隊キングオージャー』の世界がどのように形作られてきたのか資料も交えて紹介します。

この書籍のために上堀内佳寿也監督や大森敬仁プロデューサーをはじめ総勢25名のスタッフに取材を行い、インタビューやコメントとして掲載。そのほかに、ソニーPCLの技術監修のもと制作したバーチャルプロダクションの技術紹介ページや用語解説なども掲載。作品を新たな観点から楽しめる、盛りだくさんの1冊です。

- 発売日 : 2024年4月10日

- 定価:2,800円(税別)

- 監修 : 東映株式会社

- 仕様 : B5横長サイズ・144ページ・帯付き

- ISBN : 9784768318911

- 電子版あり

玄光社公式サイト

https://www.genkosha.co.jp/gmook/?p=33815

Amazon

https://amzn.to/3TWyy8M